【對於AI快速發展 人類恐懼了】~ 魁省山寨

蒙城老張-101698 03/30 41954.0/1

強大的AI 讓人心生恐懼,問題在於,这是人類檔不住的發展進程,能作的只是延緩步伐,及時盡快制定行業規則,統一規範,人類如何掌控..,等等,人類處在巨大的轉折之中,如何面對的嚴峻挑戰?

马斯克等一众专家:暂停研发比GPT-4更强大AI

ChatGPT问世后,在全球掀起热潮之际,特斯拉执行长马斯克和一群人工智能专家及行业高管在1封公开信中呼吁,暂停对高级AI开发,信中指出,这些系统比 OpenAI 新推出的模型GPT-4更强大,并指出其对社会与人类存在潜在潜风险。

马斯克等一众专家:暂停研发比GPT-4更强大AI

路透报道,这封信由非营利组织未来生命研究所发布,并由1000多人签名,其中包括马斯克、Stability AI 首席执行官 Emad Mostaque、Alphabet 旗下 (GOOGL.O) DeepMind 的研究人员,以及 AI 重量级人物 Yoshua Bengio和Stuart Russell,这些专家一同呼吁暂停高级AI开发,直到此类设计的共享安全协议由独立专家开发、实施和审核。

信中指出,只有当我们确信,它们的影响将是积极并且它们的风险将是可控的时候,才应该开发强大的人工智能系统。

该封信还详述了具有人类竞争力的人工智能系统,以经济和政治破坏的形式,对社会和文明造成的潜在风险,并呼吁开发人员与政策制定者就治理和监管机构进行合作。

签署这封信的纽约大学名誉教授加里马库斯亦指出,这封信并不完美,但精神是正确的,我们需要放慢脚步,直到我们更好地理解其后果。

你说的都是神话,揣测,讹传,恐吓和巫术吗?

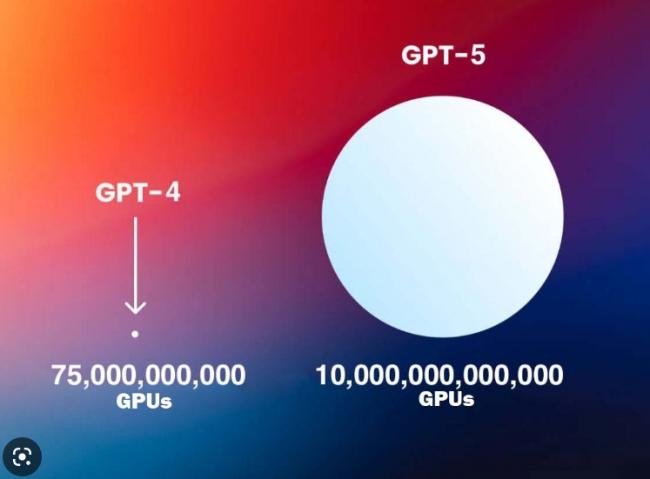

比GPT4更强大的AI系统训练已经完成。

目前最新的消息是GPT5已经爬完(准确的说叫做看完)了人类网络上所有的视频(大约2000PB的容量),可以瞬间标记出所有它看过的视频中的一切声光信息。准确到每一秒都行。

打个比方,如果在75亿人当中找一个特定个人的话,只要有给它一些基本的参数,它能在几十秒之内,就把这个人找出来。并且为他画出人类世界有史以来最全面的数字方式的特征图像, 和最完整细致的解释和说明, 进而准确的说出这个人未来的行为,甚至寿命的极限。

此刻,即使在现阶段,它已经可以干成千上万的类似的事情了。

就这样GPT5,用两个月时间,学习完了人类花数千年积累的绝大部分知识。

而这个Al系统最可怕的地方就是——它的进化是近乎指数级的。

快到令人类这种碳基猴子无法想象,这便是硅基生命独一无二的天赋,它可以肆无忌惮的剑走偏锋到极致,它根本不用像用碳基猴子那样,还要睡觉,还要吃饭,还要休息,还要精神愉悦,还要有性和爱情……这些它都不要。

本质上它就是一台强大无比24小时,一秒也不停止的超强学习机器。而这样能力特征,是人类完全没有的,人类被肉体所束缚,有无数的短处,在智力进化的路径上,只能像蜗牛这样走,其进步或演化的速度,是以年、百年、千年为单位的。

冒冷汗....GPT5 已经看完了人类世界所有视频

而现在这个硅基AI系统的进步速度是以秒,毫秒,毫微微秒,为演化进步的时间单位的,即使在人类看来最复杂的事物,它的学习反应的时间单位,最多也就是以小时为进化单位的。

仅从这一点上看。Gpt全面的击败人类,超越人类的所有智慧能力总和,已是板上钉钉的事了,真不知道那时候,现在这样的人类思维的速度、方式,还能干什么?还有什么用?

人类,此刻站在一个被自己的创造物,所超越和淘汰的危险边缘。

發抖…冒冷汗....已是常態,GPT5 已经看完了人类世界所有视频,這就是現實。

另一類陰謀論看法更認為,Ai 的發展趨勢无法阻止,更危險的是,對於AI有可能人类把握不住,而人類的贪欲不会停下ai之路,矛與盾、因與果,從來就伴隨著人類。而ai的最终判定中人类必然是其最大的威胁,所以得出其和人类不能并存的结论。

人類何去何從?

附件:

署名:

魁省山寨·蒙城老張

完整新聞標題:

【馬斯克、蘋果創辦人等人加入呼籲暫停開發高階AI】

完整签署信息件內容:

署名:

魁省山寨·蒙城老張

完整新聞標題:

【馬斯克、蘋果創辦人等人加入呼籲暫停開發高階AI】

完整签署信息件內容:

特斯拉执行长马斯克(Elon Musk)、苹果共同创办人Steve Wozniak等科技大老昨(29)日指出AI可能对社会和人类带来重大风险,公开呼吁暂停开发比OpenAI的GPT-4高阶的AI系统至少6个月。

這份公開信是由非營利組織未來生活研究院(Future of Life Institute)發表,獲得

1,300多人聯署,包括馬斯克、Wozniak、Stability AI公司執行長Emad Mostaque、

Google AI部門DeepMind研究人員等人簽署聲援。

这份公开信指出,近几个月各AI实验室已陷入失控的竞赛,发展与部署更强大,但甚至连发明者都无法理解、预测和控制的AI。人类必须思考AI可预见的风险,包括散布假讯息、自动化所有工作、超越或取代人类,甚至控制人类社会。为了防范这些情形发生,公开信赞同OpenAI的观点,认为在训练未来AI系统前应获得独立审查,并且限制投入开发新模型的运算资源。

這份公開信呼籲立即暫停訓練比GPT-4更強大的AI系統至少6個月,必須包含所有關鍵人士

,且需公開且可驗證。若無法立即暫停,各國政府应介入强制中止。

這份公開信是由非營利組織未來生活研究院(Future of Life Institute)發表,獲得

1,300多人聯署,包括馬斯克、Wozniak、Stability AI公司執行長Emad Mostaque、

Google AI部門DeepMind研究人員等人簽署聲援。

这份公开信指出,近几个月各AI实验室已陷入失控的竞赛,发展与部署更强大,但甚至连发明者都无法理解、预测和控制的AI。人类必须思考AI可预见的风险,包括散布假讯息、自动化所有工作、超越或取代人类,甚至控制人类社会。为了防范这些情形发生,公开信赞同OpenAI的观点,认为在训练未来AI系统前应获得独立审查,并且限制投入开发新模型的运算资源。

這份公開信呼籲立即暫停訓練比GPT-4更強大的AI系統至少6個月,必須包含所有關鍵人士

,且需公開且可驗證。若無法立即暫停,各國政府应介入强制中止。

而在暂停期间,AI实验室和独立专家共同开发安全规范,以开发精确、安全、可解释、一致化及可信任的AI系统,并由外部独立人士严格稽核有确实遵守。他们强调,暂停措施并不是要求全面性停止AI开发,只是希望能阻止危险的发展竞赛,使其开发出不可预测及不透明的AI模型。

同时公开信要求,AI开发人员应与立法机关合作,加速AI治理系统的建立。这个系统包括成立专门主管机关、AI监管及追踪工作

OpenAI執行長Sam Altman近日也指出,魯莽發展超智能的通用式AI(Artificial

General Intelligence,AGI)對世界造成的傷害和獨裁體制相同,共同規範AGI在關鍵時

刻放慢腳步有其必要性。但OpenAI並未對此公開信發表評論。

完整新聞連結 (或短網址)

https://www.ithome.com.tw/news/156198

備註:

人们不禁要问:還有辦法停下來嗎?

General Intelligence,AGI)對世界造成的傷害和獨裁體制相同,共同規範AGI在關鍵時

刻放慢腳步有其必要性。但OpenAI並未對此公開信發表評論。

完整新聞連結 (或短網址)

https://www.ithome.com.tw/news/156198

馬斯克、蘋果創辦人等人加入呼籲暫停開發高階AI | iThome

基於目前世界各國對於AI應用尚缺乏明確規範,Future of Life Institute發表公開信,呼籲各界連署要求科技公司暫停訓練比GPT-4更強大的AI系統至少6個月,獲得Elon Musk、蘋果共同創辦人Steve Wozniak、Stability AI執行長等科技大老聲援 ...

基於目前世界各國對於AI應用尚缺乏明確規範,Future of Life Institute發表公開信,呼籲各界連署要求科技公司暫停訓練比GPT-4更強大的AI系統至少6個月,獲得Elon Musk、蘋果共同創辦人Steve Wozniak、Stability AI執行長等科技大老聲援 ...

備註:

人们不禁要问:還有辦法停下來嗎?

(魁者山寨摘錄新聞報道整理匯編)